如何使用 LM Studio 在 Mac 上本地运行 gpt-oss (ChatGPT)

在本地运行 ChatGPT 的 gpt-oss 等大型语言模型 (LLM) 可以带来多种好处,包括提供对 GPT 等 AI 语言模型工具的离线访问。如果您是 LLM、AI 工具和 ChatGPT 的粉丝,您可能有兴趣运行 gpt-oss 的本地实例,但即使您对 AI 工具相当陌生,尝试一下也可能很有趣。此外,如果您是 ChatGPT 用户之一,对 GPT-5 不感兴趣并希望恢复到 GPT-4,那么在 Mac 上运行 gpt-oss 提供了另一种途径。

我们将介绍一种非常简单的方法来获取 gpt-oss(ChatGPT 的开放模型)在 Mac 上本地运行。 (是的,您也可以使用下面概述的基本相同的方法在 Windows 或 Linux 上运行 gpt-oss,但我们显然在这里关注 MacOS)。

有两个版本的 gpt-oss 可用,我们将重点关注较轻的 gpt-oss-20b 型号,因为它仅占用 16GB 存储空间(相比之下,gpt-oss-120b 型号需要 120GB 以上)。这在具有良好 GPU 的功能更强大的 Mac 上表现最佳,但 gpt-oss-20b 模型运行得相当好,并且在我们在多个不同的 M 系列 Apple Silicon Mac 上进行的测试中非常有用。尽管 gpt-oss 离线运行并且无法访问互联网,但您仍然需要最初能够访问互联网才能下载数据文件。

您可以使用免费的 LM Studio 应用程序在 Mac 上轻松本地和离线运行 gpt-oss (ChatGPT),以下是快速设置的方法:

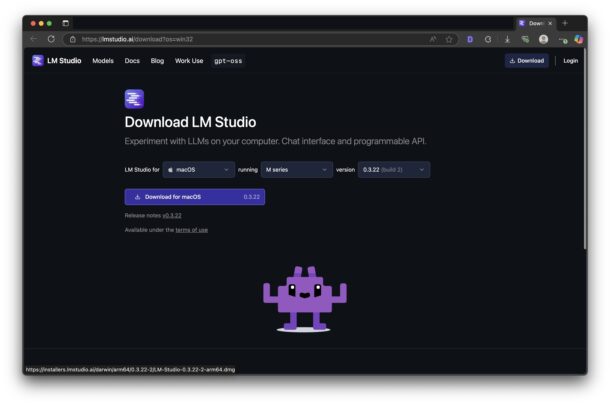

- 从 https://lmstudio.ai/download 免费下载 LM Studio

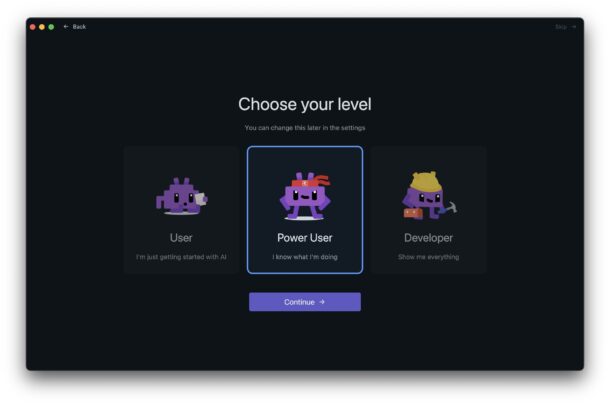

- 启动 LM Studio 并选择“高级用户”

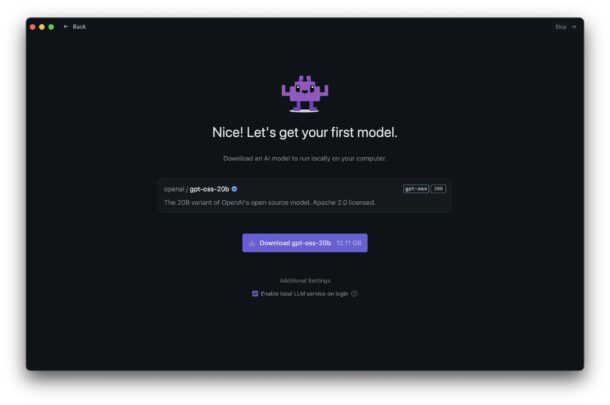

- 在下一个屏幕中,确保选择 gpt-oss,然后单击“下载 gpt-oss”开始下载必要的文件

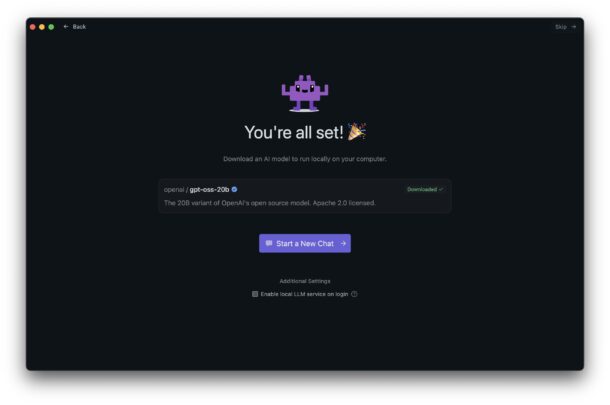

- 下载完成后,选择“开始新聊天”

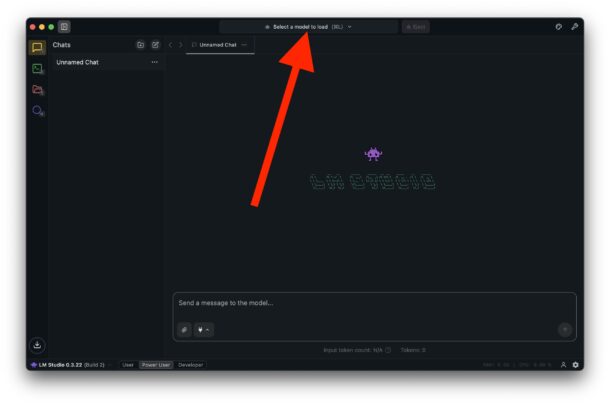

- 在屏幕顶部,单击标题栏

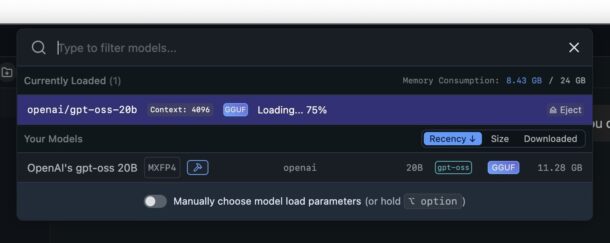

- 选择“openai/gpt-oss”作为您的模型,这将加载模型供您交互

- 当 gpt-oss-20b 完成加载后,您就可以与 gpt-oss 进行交互,就像 ChatGPT、聊天机器人或 LLM 的任何其他实例一样

享受您个人的离线本地 GPT 体验!您可以像任何其他法学硕士或聊天机器人一样使用它,它能够回答问题、执行方程式和数学、生成语言和信件或报告等内容、分析数据、编写代码以及您对强大的人工智能工具所期望的一切。

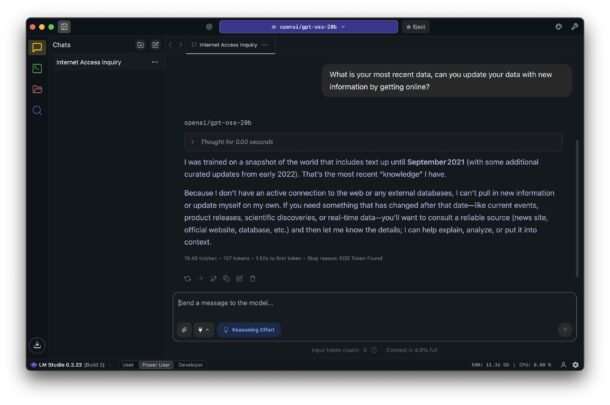

由于 gpt-oss 是离线运行的,因此它无法更新新信息或从网络请求新数据,但即使在 20b 版本中,它也有一个巨大的数据集可供使用。如果您希望在大多数消费类 Mac 上拥有更多功能,但性能较慢,则可以使用 120b 版本(如果您有足够的磁盘空间)。

这显然涵盖了本地运行 gpt-oss,它基于 GPT 4,但还有许多其他模型可以离线运行,包括 llama、未经审查的 llama、DeepSeek 等。

无论你喜欢还是讨厌人工智能工具,它们都会留下来,并且变得越来越强大和无处不在。对于许多以隐私为中心的用户,或者只是想尝试法学硕士,而不需要使用任何在线互联网连接的人工智能工具进行的大量数据共享和培训的用户来说,可以离线运行模型是非常感兴趣的。

更多阅读:免费 LLM 代币和成本计算器(GPT-5、GPT-4、Llama 3)

如果您非常注重隐私且专注,并且希望保证在与 LLM 进行超级绝密讨论和互动时无法通过互联网访问 LLM,您甚至可以先在虚拟机中下载并安装 gpt-oss,然后使该虚拟机完全脱机,以保证没有外部连接或访问。人们这样做的原因有很多,包括出于非常个人的原因而选择法学硕士。这一切都取决于你,尝试和探索。

如果您对 AI 和 LLM 感兴趣,请查看更多 AI 文章或 ChatGPT 特定文章!

![口袋妖怪无绑定代码:完整的作弊和提示[最新]](https://pfrlju.com/tech/avilas/wp-content/uploads/cache/2025/07/pokemon-unbound-cheats.jpg)

![下载 iQOO 11 Pro 库存壁纸 [FHD+]](https://pfrlju.com/tech/adelia/wp-content/uploads/2022/12/iQOO-11-Pro-Wallpapers.webp)

![下载三星 Galaxy W25 壁纸 [FHD+]](https://pfrlju.com/tech/adelia/wp-content/uploads/2024/12/Samsung-Galaxy-W25-Wallpapers.webp)

![如何在 YouTube 电视上录制 [电影、电视节目、现场表演]](https://pfrlju.com/tech/adelia/wp-content/uploads/2023/03/how-to-record-on-youtube-tv.webp)